Edge AI nei dispositivi consumer: perché conta

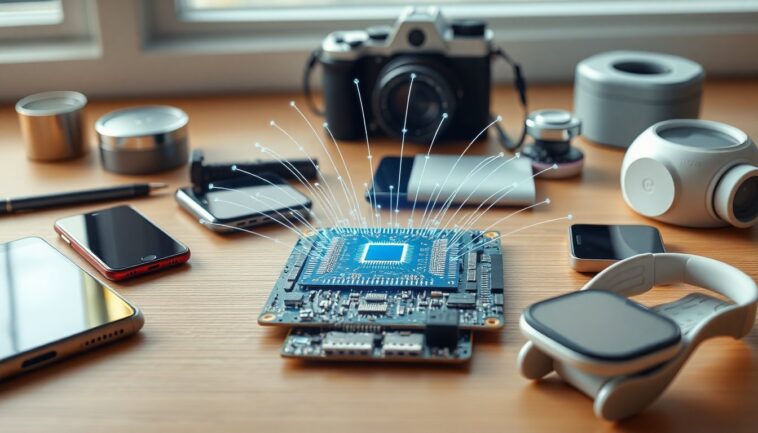

Edge AI sposta l’intelligenza direttamente sui dispositivi che usiamo ogni giorno: smartphone, fotocamere, cuffie, elettrodomestici e wearable. Invece di inviare continuamente dati al cloud, l’elaborazione avviene a bordo, con evidenti benefici in termini di reattività, riservatezza e autonomia. Dietro a questa svolta ci sono modelli ridimensionati, ottimizzazioni software e acceleratori hardware integrati nei SoC, che insieme rendono possibile l’inferenza on-device anche su piattaforme con risorse limitate.

Come funziona, in parole semplici

L’Edge AI esegue modelli di machine learning direttamente su CPU, GPU o NPU presenti nel dispositivo. Per entrare nel dettaglio, gli sviluppatori riducono le dimensioni e la complessità dei modelli tramite tecniche come quantizzazione, pruning e distillazione, e poi sfruttano compiler e toolchain pensati per l’embedded.

I dati provenienti dai sensori (microfoni, fotocamere, accelerometri) vengono preprocessati in tempo reale e sottoposti a inferenza locale, evitando trasferimenti continui verso server remoti. Grazie agli acceleratori dedicati e alle ottimizzazioni, la latenza può scendere di un ordine di grandezza rispetto a un’analisi nel cloud, ma questo richiede anche una gestione attenta dell’energia e meccanismi sicuri per aggiornare i modelli sul campo.

Punti di forza e limiti concreti

I vantaggi pratici sono immediati: risposte quasi istantanee, minore esposizione dei dati sensibili e funzionamento indipendente dalla rete. Questo si traduce in risparmi di banda e in maggiore resilienza in ambienti con connettività intermittente. Però non è tutto rose e fiori: i vincoli di memoria e potenza impongono compromessi su dimensione e accuratezza dei modelli, e distribuire aggiornamenti su milioni di dispositivi è un problema operativo non banale.

Inoltre, la sicurezza fisica e del firmware rimane un punto critico: un dispositivo vulnerabile in campo può diventare un punto di attacco.

Applicazioni concrete che già usiamo (o vedremo presto)

Edge AI non è solo teoria: la vediamo già nelle fotocamere che riconoscono volti e scene, negli assistenti vocali che rispondono anche senza connessione, nelle cuffie con cancellazione del rumore adattiva e nei droni che prendono decisioni in volo. In ambito automotive supporta funzioni di assistenza alla guida a bassa latenza; nel mondo medicale, wearable e dispositivi portatili fanno analisi in tempo reale dei parametri fisiologici per interventi tempestivi. In molti casi i modelli ottimizzati raggiungono livelli di accuratezza comparabili a quelli eseguiti in cloud, pur richiedendo molta meno potenza di calcolo.

Il mercato e chi guida l’innovazione

La corsa ai chip per Edge AI è guidata da produttori di SoC che integrano NPU e da aziende software che sviluppano tool di ottimizzazione e deployment. La competizione si gioca sull’efficienza energetica, sul throughput inferenziale e sulla capacità di gestione dei modelli distribuiti. Sempre più spesso vediamo soluzioni scalabili per fasce di prezzo diverse, il che favorisce la diffusione in smartphone, videocamere, device IoT e wearables. Gli investimenti in ricerca e sviluppo continuano a essere il motore che spinge verso nuovi livelli di integrazione hardware-software.

Cosa aspettarsi nei prossimi anni

Il futuro porterà NPU più potenti e tecniche di compressione sempre più sofisticate, così da eseguire modelli più complessi direttamente sul dispositivo.

Le metriche di riferimento si sposteranno dall’unico parametro della velocità a indicatori più sfumati come efficienza energetica, robustezza degli aggiornamenti OTA e interoperabilità tra ecosistemi diversi. L’evoluzione naturale è verso architetture ibride che bilanciano carga e privacy, e verso standard condivisi per la gestione sicura dei modelli.

Riflessioni pratiche per chi sviluppa e produce

Sviluppatori e OEM dovranno orientarsi verso modelli progettati per l’edge: più leggeri, facili da aggiornare e robusti dal punto di vista della sicurezza. Strumenti automatici per convertire modelli cloud in versioni compatibili con l’edge stanno già accelerando il deployment e abbattendo i costi operativi. Sul fronte hardware, molte NPU consumer oggi offrono capacità nell’ordine di 1–10 TOPS (trilioni di operazioni al secondo), sufficienti per numerose applicazioni on-device. Rimangono sfide tecniche e operative — dalla gestione dell’energia agli aggiornamenti sicuri — ma trend tecnologici e investimenti stanno rendendo l’Edge AI sempre più praticabile e diffusa. Chi saprà combinare modelli efficienti, toolchain robuste e hardware adeguato avrà un vantaggio significativo nel mercato dei dispositivi consumer.